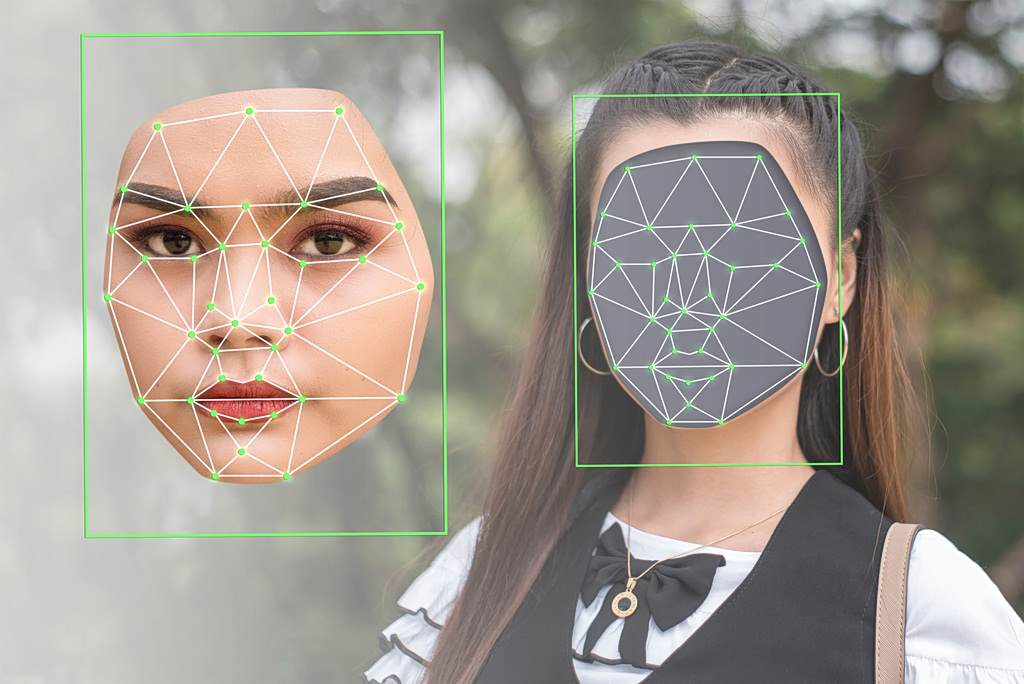

Ψευδείς ψηφιακές απεικονίσεις με τεχνητή νοημοσύνη (Deepfakes) σε Νότια Κορέα, Ινδία και Αυστραλία αναδεικνύουν τον αυξανόμενο κίνδυνο που δημιουργεί η χρήση deepfake περιεχομένου για δημόσια πρόσωπα και δημοκρατικές διαδικασίες.

Τα περιστατικά κυμαίνονται από μη εξουσιοδοτημένη χρήση της εικόνας διασήμων έως κατασκευασμένα πολιτικά βίντεο που στοχεύουν στην παραπλάνηση των ψηφοφόρων.

Νότια Κορέα: Χρήση προσώπου γνωστής ηθοποιού χωρίς άδεια

Στη Νότια Κορέα, το πρακτορείο της γνωστής ηθοποιού Yeom Hye-ran, Ace Factory, επιβεβαίωσε στις 31 Μαρτίου ότι η ταινία που δημιουργήθηκε με τεχνητή νοημοσύνη, με τίτλο “Geomchimwon”, χρησιμοποίησε την εικόνα της χωρίς τη συγκατάθεσή της.

«Επιβεβαιώσαμε σήμερα ότι ένα βίντεο που δημιουργήθηκε με AI και χρησιμοποιεί το πορτρέτο της Yeom Hye-ran χωρίς εξουσιοδότηση, αναρτήθηκε στο YouTube», ανέφερε η εταιρεία σε δήλωσή της στο OSEN. «Η εταιρεία μας δεν είχε καμία προηγούμενη επικοινωνία ή άδεια σχετικά με την παραγωγή αυτού του βίντεο». Μετά την έντονη αντίδραση, το βίντεο αποσύρθηκε από την πλατφόρμα.

Ινδία: Πολιτικός καταγγέλλει ψεύτικο βίντεο επαίνου προς το Πακιστάν

Στην Ινδία, ο βουλευτής του Κόμματος του Κογκρέσου Shashi Tharoor κατήγγειλε deepfake βίντεο που τον εμφάνιζε ψευδώς να επαινεί την ομάδα κρίκετ του Πακιστάν για τη στάση της σχετικά με το μποϊκοτάζ του Παγκοσμίου Κυπέλλου ICC Men’s T20 2026.

Το παραποιημένο βίντεο, το οποίο –σύμφωνα με τον ίδιο– διαδόθηκε από «πακιστανικές ιστοσελίδες παραπληροφόρησης», τον παρουσίαζε να κάνει δηλώσεις που χαρακτήρισε «α nemόητες». «Αν δεν το έχω αναρτήσει εγώ, μην το πιστεύετε», προειδοποίησε στα μέσα κοινωνικής δικτύωσης, επισημαίνοντας ασυμφωνίες στην κίνηση των χειλιών και αλλοιωμένο ήχο. Το αρχικό υλικό, όπως ανέφερε η εφημερίδα *Times of India*, αφορούσε ομιλία του Tharoor για τον διαχωρισμό πολιτικής και αθλητισμού.

Αυστραλία: Deepfake της πρωθυπουργού Βικτώριας προκαλούν ανησυχία

Στην Αυστραλία, ψεύτικα βίντεο της πρωθυπουργού της Βικτώριας Jacinta Allan κυκλοφόρησαν στα μέσα κοινωνικής δικτύωσης, προκαλώντας ανησυχία για την πιθανή επίδραση της τεχνητής νοημοσύνης στις εκλογές του Νοεμβρίου.

Ειδικοί προειδοποίησαν ότι τέτοιο περιεχόμενο είναι δύσκολο να αντιμετωπιστεί, καθώς οι ψηφοφόροι δυσκολεύονται να «ξεχάσουν» όσα έχουν δει, ακόμη κι αν αποδειχθούν ψευδή, σύμφωνα με την εφημερίδα *Herald Sun*. Το *Sky News* μετέδωσε ότι τα βίντεο έμοιαζαν με αυθεντικές συνεντεύξεις Τύπου, καθιστώντας την εξαπάτηση ακόμη πιο δύσκολο να εντοπιστεί από το κοινό.

Τα περιστατικά αυτά υπογραμμίζουν την ταχύτητα με την οποία εξελίσσεται η τεχνολογία των deepfakes, ξεπερνώντας τις ρυθμιστικές αρχές και τις πλατφόρμες κοινωνικής δικτύωσης. Δημόσια πρόσωπα σε όλο τον κόσμο βρίσκονται πλέον αντιμέτωπα με την ανάγκη να αντιμετωπίζουν την παραπληροφόρηση σχεδόν μόνα τους.