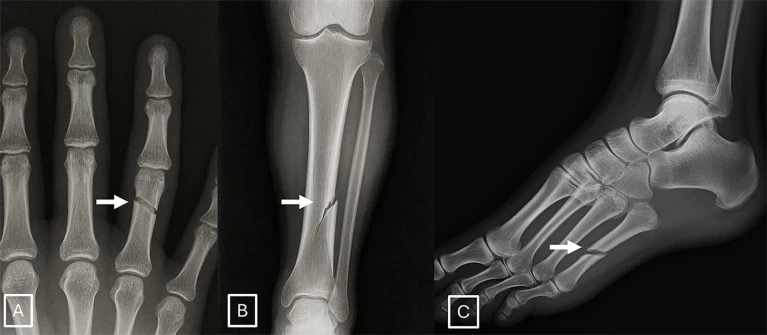

Οι ακτινογραφίες δημιουργημένες με τη χρήση τεχνητής νοημοσύνης γίνονται πλέον τόσο ρεαλιστικές, ώστε μπορούν να παραπλανήσουν ακόμη και τους πιο έμπειρους ιατρούς, σύμφωνα με μελέτη που δημοσιεύτηκε στο περιοδικό Radiology της Ακτινολογικής Εταιρείας της Βόρειας Αμερικής στις 24 Μαρτίου. Οι ακτινολόγοι κατάφεραν να διακρίνουν σωστά τις αυθεντικές από τις συνθετικές ακτινογραφίες μόνο στο 75% των περιπτώσεων, παρότι γνώριζαν ότι υπήρχαν deepfakes στο δείγμα.

Η έρευνα, που παρουσιάστηκε από το sciencenews.org, περιλάμβανε 17 ακτινολόγους από 12 ερευνητικά κέντρα σε έξι χώρες — τις Ηνωμένες Πολιτείες, τη Γαλλία, τη Γερμανία, την Τουρκία, το Ηνωμένο Βασίλειο και τα Ηνωμένα Αραβικά Εμιράτα. Οι ειδικοί εξέτασαν 264 ακτινογραφίες, εκ των οποίων οι μισές ήταν πραγματικές και οι υπόλοιπες δημιουργήθηκαν από τεχνητή νοημοσύνη. Όταν οι συμμετέχοντες δεν γνώριζαν τον σκοπό της μελέτης, μόλις το 41% υποψιάστηκε ότι υπήρχαν συνθετικές εικόνες στο σύνολο δεδομένων.

«Η μελέτη μας αποδεικνύει ότι αυτές οι ψεύτικες ακτινογραφίες που δημιουργούνται με τεχνητή νοημοσύνη είναι αρκετά ρεαλιστικές ώστε να ξεγελούν τους ακτινολόγους, τους πιο εξειδικευμένους ειδικούς σε ιατρικές απεικονίσεις, ακόμα και όταν γνώριζαν ότι υπήρχαν εικόνες που δημιουργήθηκαν από τεχνητή νοημοσύνη», δήλωσε ο επικεφαλής συγγραφέας Mickael Tordjman, ακτινολόγος στην Ιατρική Σχολή Icahn του Mount Sinai στη Νέα Υόρκη.

Η ακρίβεια των επιμέρους συμμετεχόντων κυμάνθηκε από 58% έως 92%, χωρίς να υπάρχει συσχέτιση με τα χρόνια εμπειρίας, τα οποία κυμαίνονταν από μηδέν έως 40. Οι ακτινολόγοι του μυοσκελετικού συστήματος εμφάνισαν υψηλότερη επίδοση. Παράλληλα, τέσσερα πολυτροπικά μεγάλα γλωσσικά μοντέλα — μεταξύ αυτών τα GPT-4o και Gemini 2.5 Pro — δοκιμάστηκαν και σημείωσαν ποσοστά ακρίβειας από 57% έως 85% σε εικόνες που είχαν δημιουργηθεί μέσω ChatGPT.

Απάτη, κυβερνοασφάλεια και προληπτικά μέτρα

Τα ευρήματα προκαλούν ανησυχία πέρα από τα τμήματα ακτινολογίας. Ο Tordjman προειδοποίησε για «μια ευπάθεια υψηλού διακυβεύματος για δόλιες αγωγές αν, για παράδειγμα, ένα πλαστό κάταγμα μπορούσε να είναι αδιάκριτο από ένα πραγματικό». Επισήμανε επίσης κινδύνους κυβερνοασφάλειας, εάν χάκερ επιχειρήσουν να εισάγουν συνθετικές εικόνες σε νοσοκομειακά δίκτυα με σκοπό τη χειραγώγηση διαγνώσεων.

Η μικροβιολόγος και ειδικός ακεραιότητας εικόνων Elisabeth Bik δήλωσε στο Nature ότι τα αποτελέσματα είναι «ταυτόχρονα ανησυχητικά και όχι ιδιαίτερα εκπληκτικά». Όπως ανέφερε, η απειλή εκτείνεται στην «ακεραιότητα της έρευνας, στις κλινικές ροές εργασίας, στις ασφαλιστικές απαιτήσεις και σε νομικά πλαίσια όπου χρησιμοποιούνται απεικονιστικά στοιχεία».

«Οι ιατρικές εικόνες deepfake συχνά φαίνονται υπερβολικά τέλειες», σημείωσε ο Tordjman, εξηγώντας ότι ενδεικτικά σημάδια είναι τα υπερβολικά λεία οστά, οι αφύσικα ίσιες σπονδυλικές στήλες και τα υπερβολικά ομοιόμορφα μοτίβα αιμοφόρων αγγείων. Οι ερευνητές προτείνουν ως αντίμετρα την προσθήκη αόρατων υδατογραφημάτων και κρυπτογραφικών υπογραφών τη στιγμή της λήψης των εικόνων.

«Δυνητικά βλέπουμε μόνο την κορυφή του παγόβουνου», κατέληξε ο Tordjman, επισημαίνοντας ότι «το επόμενο λογικό βήμα είναι η παραγωγή συνθετικών τρισδιάστατων εικόνων με τεχνητή νοημοσύνη, όπως αξονικές και μαγνητικές τομογραφίες». Τόνισε ότι η ανάπτυξη εκπαιδευτικών συνόλων δεδομένων και εργαλείων ανίχνευσης είναι πλέον κρίσιμη για τη διασφάλιση της αξιοπιστίας στις ιατρικές απεικονίσεις.